Was ist die neue DGX Station – und für wen lohnt sie sich?

Die DGX Station richtet sich an KI‑Teams, die große Modelle und datenintensive Pipelines lokal entwickeln möchten – ohne typische Wartezeiten auf geteilte Cluster‑Ressourcen und ohne zwingende Cloud‑Abhängigkeit. Sie kombiniert einen Blackwell‑Ultra‑GPU‑Teil mit einer Grace‑CPU in einem Superchip‑Design, optimiert für KI‑Training, Inferenz, Simulation und moderne Agentic‑Workflows.

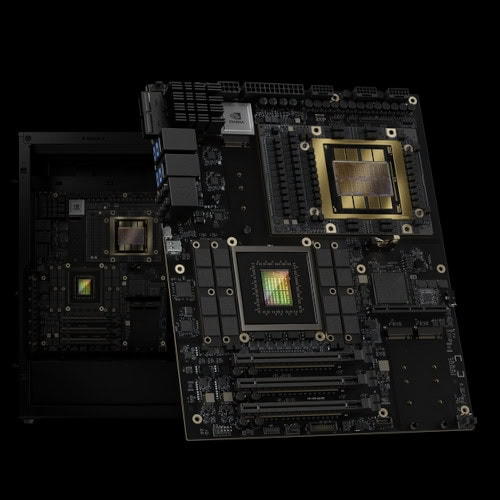

Der technische Kern: GB300 Superchip + NVLink‑C2C

Im Zentrum steht der NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip: CPU und GPU sind per NVLink‑C2C (900 GB/s) kohärent verbunden. Das Ziel ist ein schneller, gemeinsamer Adressraum für Daten – entscheidend, wenn Modelle, Kontextfenster, Embeddings oder Simulationsdaten sehr groß werden.

- CPU: Grace mit 72 Arm Neoverse V2 Cores (Workstation‑/Server‑Klasse)

- GPU: NVIDIA Blackwell Ultra (Tensor Cores mit NVFP4‑Support)

- Coherent Memory: 748 GB (252 GB HBM3e + 496 GB LPDDR5X)

- AI Compute: bis zu 20 petaFLOPS (Tensor‑Core, je nach Modus/Annahme)

I/O, Erweiterung und Betrieb

Neben dem Superchip‑Kern ist die Plattform auf produktive Integration ausgelegt: schnelle NVMe‑Storage‑Pfade, mehrere PCIe‑Slots für Erweiterungen (z. B. Display‑/I/O‑Optionen) sowie ein Management‑Pfad (BMC) für professionellen Betrieb im Enterprise‑Umfeld.